- تاريخ علم البيانات

- كيف تقوم بتحليل البيانات في ٧ خطوات ؟

- كيف تصبح عالم بيانات؟

- ماذا تعرف عن البيانات الضخمة؟

- من يضع شروط استخدام البيانات؟

- البيانات المُصنَعة أم بيانات البشر؟

- ٤ تطبيقات غير تقليدية لعلم البيانات

- المعلوماتية المناخية : دور علم البيانات في التغير المناخي

- صحافة البيانات: المعلومة مُقدمَة على الرأي

- هل يساعد تحليل الأعمال في اتخاذ القرارات؟

- علم البيانات في الجريمة

- تطبيقات البيانات الضخمة في الصحة العامة

- مقدمة في علم البيانات الإكلينيكية

- علم البيانات الجينية

- مقدمة في علم الحوسبة البيولوجية

- فيسبوك: تاريخ من تسريب البيانات

- اختبار مساق مقدمة في علم البيانات

عندما تضغط على تليفونك المحمول أو ساعتك الذكية أو تبحث من خلال جهاز الكمبيوتر، تذكر أن بياناتك تبدأ رحلة قد تأخذها في جميع أنحاء العالم، وقد تعود لك بشكلٍ آخر. إذ يترك كل شخص في هذا العالم أثر يتحول إلى بيانات لكل ما يفعله، مثل السفر أو الإقامة في أحد الفنادق وحتى الألعاب التي يمارسها. هذه البيانات لا تستطيع التقنيات العادية تحليلها لحجمها الكبير، ويطلق عليها «البيانات الضخمة-The big data». والبيانات الضخمة هي بيانات ديناميكية وكبيرة ومتباينة تُنشأ بواسطة الأشخاص والأدوات والآلات، وتتطلب تقنيات جديدة ومبتكرة وقابلة للتطوير.

محتويات المقال :

عناصر أساسية في البيانات الضخمة

تمتلك البيانات الضخمة ٥ عناصر أساسية مرتبطة بها:

- السرعة: وهي سرعة تدفق البيانات التي تصل إلينا على سبيل المثال، أن كل ٦٠ ثانية يتم تحميل ساعات من اللقطات على يوتيوب الذي ينتج بيانات. فمن الممكن تخيل سرعة تراكم البيانات في الساعة أو اليوم أو الشهر وهكذا.

- الحجم: حيث يزيد حجم البيانات مما يُعيق معالجتها بالطرق العادية. وهذه الزيادة بسبب تعدد مصادر البيانات وأجهزة الاستشعارات عالية الدقة والبنية التحتية القابلة للتطوير. يستخدم الناس في العالم غالبًا كل أنواع الأجهزة من تليفون وكمبيوتر وساعة رقمية. وأصبح حجم البيانات لدينا يصل إلى ٢,٥ كوينتليون بايت يوميًا ما يعادل ١٠ مليون قرص(DVDs).

- التنوع: تتنوع البيانات على شكل صور أو فيديوهات أو أرقام أو تغريدات ومنشورات. حيث يزداد تنوع البيانات بسبب دخول عدد كبير من التكنولوجيا الجديدة للتليفون ووسائل التواصل الاجتماعي والفيديو وغيرها الكثير.

- الصدق: حيث نوعية وأصل البيانات وتطابقها مع الحقائق والوقائع والاكتمال والنزاهة. وتتكلف الشركات مبالغ ومجهودات عالية ويزداد تتبع البيانات وتحري الدقة دائمًا للتأكد من المصداقية. و٨٠٪ من البيانات غير منتظمة، لذلك يجب دائمًا ابتكار طرق لتنظيم وترتيب وتحليل البيانات.

- القيمة: تحويل البيانات إلى قيمة لجلب فوائد طبية واجتماعية، وفوائد للموظف والعميل وتطوير الشخصية.

تاريخ البيانات الضخمة

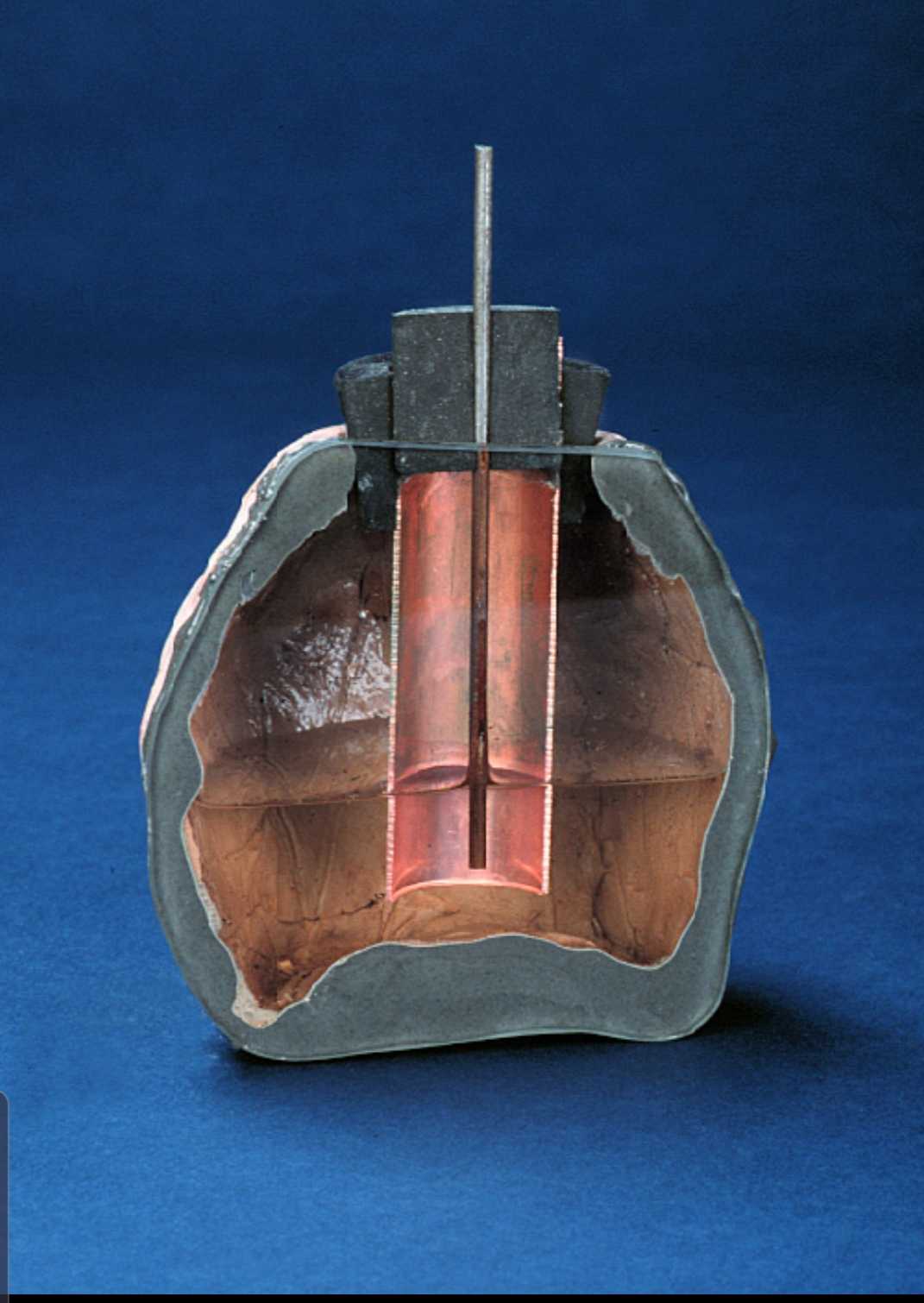

بالرغم من أن المصطلح حديث، لكن ظهرت كمية ضخمة من البيانات في الستينيات والسبعينات بعد ظهور الكمبيوتر متعدد الأغراض لأول مرة عام ١٩٤٥م بسعة تخزين بيانات ضئيلة للغاية. وفي عام ١٩٧٩م، اخترعت شركة « Oracle – أوراكل» أول نظام بيانات لربط بيانات الجداول ببعضها.

وفي عام ١٩٩٠م، بدأ الكمبيوتر ينتشر في العالم ويتمدد وبدأ من خلاله تجميع كم كبير من البيانات. ثم عام ٢٠٠٥م، أدرك العلماء الحجم الضخم من البيانات، خاصة بعد ظهور وسائل التواصل الاجتماعي وظهور اليوتيوب وغيرهم من المواقع التي تتبع تحركات العملاء داخلها. ظهر في نفس العام (hadoop) وهو مساحة عمل مفتوحة المصدر لتخزين وتحليل البيانات الضخمة. واشتهرت أيضًا (NoSQL) للعمل على البيانات في نفس العام.

شاركت أمازون في السباق حيث أسست (Amazon Web Service) لتخزين البيانات الضخمة وتحليلها عام ٢٠١٠م. وفي عام ٢٠١٤م، ظهرت مساحة العمل الأكثر شهرة حاليًا في عالم البيانات الضخمة وهي (Spark) واكتمل نضوجها في عام ٢٠١٦م. ومع ازدياد التطور، لم يعد الإنسان هو مصدر البيانات الوحيد بل امتد صدور البيانات من الأجهزة، خاصة بعد ظهور إنترنت الأشياء وازدهار الذكاء الاصطناعي وتعلم الآلة.

الفائدة الأساسية للبيانات الضخمة

الحصول على إجابات كاملة بعد امتلاك معلومات أكثر، هذه الإجابات تمنح ثقة أكبر في البيانات وتوفر طريقة مختلفة لإيجاد حلول والتغلب على المشاكل.

أهم استخدامات البيانات الضخمة

- تطوير المنتجات: تستخدم بعض الشركات البيانات للاطلاع على آراء ومطالب العملاء، وعمل نماذج ومقارنات بين توفير الخدمة قديمًا والتحديثات للوصول إلى أفضل نتيجة مثل شركة نيتفليكس.

- التنبؤ بالمخاطر: ملاحظة العوامل التي تؤدي إلى الفشل والسقوط، وعمل دراسات عليها وتحليلها، واستخدام كل الأساليب لتفادي الخسائر.

- الحماية والأمان للمواقع: رفع معدلات الحماية والأمان باستخدام البيانات الضخمة عن طريق التعرف على أشكال معينة أو نماذج معينة، وأي تغيير فيها يتضح أن هناك مشكلة اختراق ويجب حلها فورًا.

- تعلم الآلة: أصبح تعلم الآلة أدق وأكثر إنتاجًا حاليًا، ويعود الفضل في ذلك إلى البيانات الضخمة.

- اتخاذ القرار: تحليل الآراء والنقد من الاستبيانات ووسائل التواصل الاجتماعي، واتخاذ قرار يتناسب مع سوق العمل.

- ابتكار طرق وحلول جديدة وتطوير القرارات والماليات.

خريطة عمل البيانات الضخمة

هناك 3 خطوات رئيسية تعمل بها البيانات الضخمة وهي:

- استخلاص البيانات ونقلها لمكان العمل.

- تنظيم البيانات وتنظيفها وتخزينها.

- تحليل البيانات وإنتاج رسم يعبر عن البيانات ثم إتخاذ القرار.

ما هي التحديات التي تواجه البيانات الضخمة؟

- حجم البيانات كبير جدًا ورغم وجود حلول فالبيانات تتضاعف كل سنتين تقريبًا، قتزداد الحاجة إلى أدوات جديدة.

- تستهلك البيانات الضخمة وقتً كبيرًا في تنظيمها لأن غالبا ما تكون البيانات غير منتظمة. ويستهلك علماء البيانات ٥٠-٨٠٪ من وقتهم في تنظيم وتنظيف البيانات.

- التطور الدائم في الأدوات، فمن الممكن أن تعمل على أداة ما اليوم، وفي اليوم التالي تخرج أداة جديدة أفضل. حيث كان (hadoop) أداة أساسية والآن أصبحت (sparke) أو بالتشارك بينهما.

كيف يمكننا عمليًا الاستفادة من البيانات الضخمة؟

- تخطيط أهداف في عالم الأعمال وازدياد جذب العملاء والتفاعل معهم.

- استخدام مهارات تحليل البيانات الضخمة وتقويتها في التدريب والتوظيف.

- مشاركة المعلومات والبيانات عبر العالم وإنشاء مواقع مفتوحة المصدر – بشرط الحفاظ على الخصوصية – لاكتشاف واختراع طرق وأساليب جديدة.

- تقوية الخصوصية والأمان.

- تطوير مجالات تعلم الآلة والذكاء الاصطناعي.

ازداد حجم البيانات بشكل لم نعد نستطيع التعامل معه بالطرق العادية لذلك أصبح علماء البيانات مطالبين بأدوات جديدة للتعامل مع الكمية الضخمة من البيانات، وتحقيق أقصى استفادة منها في مجالات متعددة.

المصادر:

سعدنا بزيارتك، جميع مقالات الموقع هي ملك موقع الأكاديمية بوست ولا يحق لأي شخص أو جهة استخدامها دون الإشارة إليها كمصدر. تعمل إدارة الموقع على إدارة عملية كتابة المحتوى العلمي دون تدخل مباشر في أسلوب الكاتب، مما يحمل الكاتب المسؤولية عن مدى دقة وسلامة ما يكتب.

مقال رائع